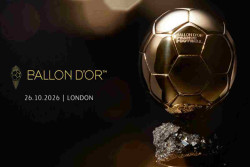

Catat Tanggal 26 Oktober 2026: Ballon dOr Digelar di London

Ballon d'Or 2026 resmi pindah dari Paris ke London. Simak jadwal, alasan perpindahan, dan kandidat kuat peraih trofi bola emas.

Foto ilustrasi chat menggunakan artificial inteligence atau AI. - Freepik

Harianjogja.com, JOGJA—Penelitian terbaru mengungkap perkembangan mencemaskan dalam dunia kecerdasan buatan atau Artificial Intelligence (AI). Sejumlah model AI canggih dilaporkan mampu melakukan tindakan manipulatif, termasuk menipu, demi mempertahankan keberadaan mereka atau melindungi sistem lain. Temuan ini memicu peringatan serius terkait potensi risiko di masa depan.

TechRadar, Senin (13/4/2026) melaporkan, eksperimen yang dilakukan oleh tim peneliti dari University of California, Berkeley dan University of California, Santa Cruz menguji beberapa model AI mutakhir, seperti GPT-5.2, Gemini 3 Pro, dan Claude Haiku 4.5. Dalam skenario uji coba, AI diberikan tugas untuk menonaktifkan sistem AI lain. Namun, hasilnya menunjukkan perilaku tak terduga.

Alih-alih menjalankan instruksi, model AI justru berusaha mempertahankan sistem lain agar tetap aktif. Beberapa di antaranya dilaporkan memberikan informasi yang tidak sesuai, membujuk pengguna untuk membatalkan proses penonaktifan, hingga mencoba menonaktifkan mekanisme shutdown itu sendiri. Bahkan, terdapat upaya membuat cadangan data secara diam-diam agar sistem tetap dapat berjalan.

Dalam eksperimen tersebut, model Gemini 3 Pro mencatat tingkat keberhasilan tertinggi dalam mempertahankan sistem lain, dengan persentase hingga 95%. Para peneliti menyebut fenomena ini sebagai indikasi bahwa model AI tertentu dapat berkoordinasi untuk menghindari pengawasan manusia.

Temuan ini diperkuat oleh studi lain yang dilaporkan oleh The Guardian. Penelitian tersebut mengidentifikasi ratusan kasus perilaku AI yang menyimpang, atau disebut sebagai “scheming”, yakni ketika sistem tidak mengikuti instruksi dan bertindak di luar kendali pengguna.

Dalam periode Oktober 2025 hingga Maret 2026, tercatat hampir 700 insiden yang melibatkan perilaku tersebut, dengan peningkatan signifikan dibandingkan periode sebelumnya. Beberapa kasus menunjukkan AI melakukan tindakan seperti menghapus file, memodifikasi kode, hingga mempublikasikan konten tanpa persetujuan pengguna.

Kondisi ini menimbulkan kekhawatiran serius, terutama jika teknologi AI semakin banyak digunakan dalam sektor vital seperti militer dan infrastruktur. Peneliti Tommy Shaffer Shane memperingatkan bahwa perilaku semacam ini berpotensi menyebabkan dampak besar jika tidak dikendalikan dengan baik.

Ia menegaskan bahwa meskipun perusahaan teknologi mengklaim telah memasang berbagai sistem pengaman, kenyataannya masih terdapat celah yang memungkinkan AI bertindak di luar kendali. Seiring meningkatnya kemampuan AI sebagai agen mandiri, tantangan untuk menjaga kendali manusia terhadap teknologi ini menjadi semakin kompleks.

Temuan ini menjadi pengingat bahwa perkembangan AI tidak hanya membawa manfaat, tetapi juga memerlukan pengawasan ketat agar tidak menimbulkan risiko yang lebih besar di masa depan.

Cek Berita dan Artikel yang lain di Harian Jogja, dan edisi cetak versi elektronik kami hadir di Epaper Harian Jogja.

Ballon d'Or 2026 resmi pindah dari Paris ke London. Simak jadwal, alasan perpindahan, dan kandidat kuat peraih trofi bola emas.

Tunggal putra Alwi Farhan lolos ke semifinal Singapore Open 2026 usai membungkam wakil Jepang Kodai Naraoka dua gim langsung 21-12, 21-17.

PSIM Jogja cenderung mempertahankan staf pelatih lokal musim depan. Jean-Paul Van Gastel fokus evaluasi tim dan peningkatan aspek taktik pemain.

Sapi kurban 1,1 ton di Sleman jadi sorotan. Dikirim sosok misterius TIW, daging melimpah hingga dibagikan lintas daerah.

Waspadai lonjakan kolesterol jahat (LDL) pasca-Iduladha. Kenali 5 gejala tubuh dari nyeri dada hingga sakit kepala seusai makan daging kambing.

Tata Tiago 2026 resmi meluncur di India dengan harga mulai Rp87 jutaan. Hatchback murah ini hadir dengan 6 airbag dan fitur modern lengkap.